Веб сервера поддерживают обычно соединение в течении какого то времени. Но что делать, если нужно скачать файл, который просто не успевает закачаться за отведенное время?

В Unix файл можно скачать по ссылке командой wget, вот так:

Но при обрыве утилита оставит только то, что успело передаться. Есть дополнительный флажок —continue для возобновления закачки. Тогда wget сделает несколько попыток продолжить закачку.

|

|

wget --continue http://file-url |

Но если файл очень длинный, то количества попыток может не хватить. Тогда нужно задать их с помощью еще одного ключа —tries=[число попыток]. При этом значение «ноль» обеспечит не ограниченное их число:

|

|

wget --continue --tries=0 http://file-url |

UNIX

Данная запись опубликована в 22.10.2019 21:51 и размещена в рубрике Программирование.

Вы можете перейти в конец страницы и оставить ваш комментарий.

Мало букафф? Читайте есчо !

Декабрь 3, 2019 г.

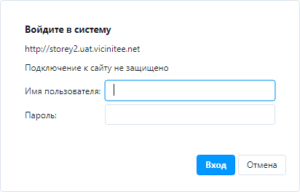

Задача возникла в контексте SEO, требовалось предотвратить индексацию тестовых сайтов поисковыми системами. На практике видно, что инструкции файла robots.txt ...

Читать

Октябрь 6, 2023 г.

Полезный пример поиска в UNIX, чтобы найти файлы, содержащие 2 и более разных подстрок. Например, мне нужно было найти все файлы конфигурации, в которых одновременно есть значение "field_spacing" и "excluded: false".

Grep такой функции поиска не ...

Читать

Июнь 22, 2017 г.

Чтобы посмотреть root пароль от mySQL на unix - хостинге, нужны:

Достаточные права (root-доступ)

Знать где смотреть :)

Первое условие вам придется обеспечить самостоятельно, а со вторым - я вам помогу. Текстовый файл с паролем в открытом ...

Читать

Сентябрь 18, 2025 г.

Столкнулся с задачей на практике - в архиве tar.gz лежит еще один архив, в котором еще один и так далее... Как с кощеевым яйцом, только цепочка в матрешке куда более длинная.

Написал небольшой скрипт для bash, по распаковке такого сюрприза.

...

Читать